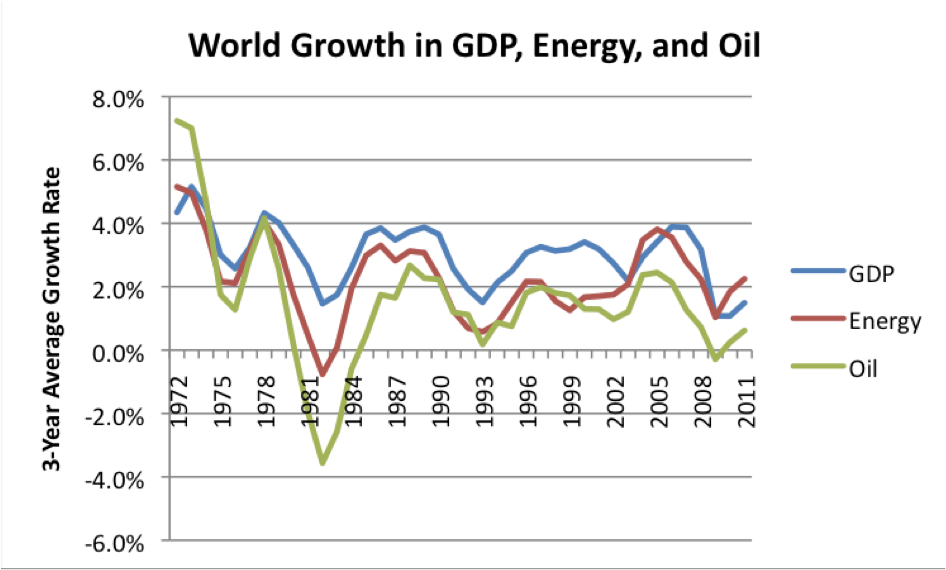

L’économie n’est que de l’énergie transformée

Ce qui a fait la grandeur et la force de l’Empire Romain, ce n’était pas uniquement ses légions, mais c’était sa capacité à capter, transporter et distribuer de l’énergie à une échelle inédite dans l’Antiquité. En ce sens, Rome était la première grande puissance infrastructurelle de l’Histoire.

En économie, la corrélation entre croissance économique et énergie transformée est extrêmement positive.

Cependant, Rome a fini par surexploiter ses ressources énergétiques. La déforestation a appauvri les sols, les aqueducs mal entretenus se sont dégradés, et l’Empire Romain a progressivement perdu sa capacité à maintenir ses infrastructures. C’est l’une des raisons de la chute de Rome (avec la bureaucratie et un trop grand cosmopolitisme) : un épuisement énergétique et infrastructurel.

Le parallèle avec l’IA est saisissant : nous construisons des systèmes énergétiques d’une puissance colossale, dont la dépendance énergétique croissante pourrait devenir son talon d’Achille, exactement comme les aqueducs le furent à l’Empire Romain.

Mais que se passerait-il si ces infrastructures énergétiques n’arrivaient plus à suivre la cadence, si l’offre ne répondait plus à la demande ?

C’est selon moi, exactement ce qu’il va se passer avec l’avènement des IA agentiques.

De l’IA générative à l’IA agentique

Le 30 novembre 2022, OpenAI sortait ChatGPT, un agent conversationnel à intelligence artificielle capable de répondre très rapidement à une question, traitant pour cela des milliards d’informations en quelques secondes. Depuis, l’IA générative est capable de créer des images, des vidéos, de générer des tableaux, des graphiques, le tout en quelques secondes seulement.

Depuis quelques mois, nous voyons arriver sur le marché de l’IA des solutions dites de vibe coding et d’IA agentique.

Le Vibe Coding est une nouvelle façon de créer des logiciels dans laquelle le développeur (ou même un non-développeur) décrit en langage naturel ce qu’il souhaite obtenir, et laisse une IA générer l’intégralité du code à sa place.

On ne code plus. On exprime une idée, une direction, et l’IA s’occupe du reste en quelques minutes.

Les solutions parmi les plus connues actuellement sont Cursor, Lovable et Microsoft Power Apps Vibe.

L’IA agentique désigne, elle, des systèmes d’intelligence artificielle encore plus poussés, capables d’agir de manière autonome, de prendre des décisions, d’enchaîner des tâches complexes et d’interagir avec leur environnement, le tout sans intervention humaine constante.

Contrairement à une IA « classique » qui répond à une question ponctuelle, l’IA agentique :

- Planifie une séquence d’actions pour atteindre un objectif

- S’adapte en cours de route si les conditions changent

- Utilise des outils (recherche web, bases de données, APIs, logiciels)

- Collabore avec d’autres agents IA spécialisés

- Fonctionne en continu, H24, sans pause

En résumé : si l’IA classique est un expert qu’on interroge, l’IA agentique est un collaborateur qui agit.

Les entreprises à la pointe de ces technologies sont OpenClaw (OpenAI), Manus (Meta), Genspark, Copilot (Microsoft), ChatGPT Agents (OpenAI), Claude (Anthropic), Gemini (Google), Agentforce (Salesforce).

Les IA sont maintenant capables de générer des logiciels uniquement à partir d’un prompt rédigé par un humain ou une IA (Vibe coding), de planifier et exécuter des actions de manière autonome (IA agentique).

Le réseau électrique à bout de souffle face à la révolution IA

Poser une question à Claude AI ou n’importe quelle autre IA (ce qui va générer une réponse unique) demande 30 fois plus d’énergie que de la demander à Google (qui indexe ses résultats, permettant d’éviter de refaire le même travail). Tout ceci demande donc une quantité considérable d’énergie.

Alors que nous n’étions qu’à l’ère des IA génératives, fin 2024 en Virginie du Nord (USA), la « Data Center Alley » a saturé le réseau et de nettes altérations du courant électrique étaient constatées dans de nombreux foyers installés dans un rayon de moins de 80 km des centres de données, où l’essentiel des centres de données américains sont concentrés.

Un rapport mené par Data Center Watch entre mars 2024 et mars 2025 constate que l’équivalent de 64 milliards de dollars de projets de centres de données sont actuellement bloqués ou retardés à travers les Etats-Unis. La cause : les questions d’accès à l’énergie et à l’eau pour refroidir les serveurs. En 2026, on parle de plusieurs centaines de milliards de dollars de projets à l’arrêt.

Partout dans le monde, la consommation d’énergie des centres de données a déjà eu pour conséquence la suspension de projets de construction de logements, faute de pouvoir les alimenter en énergie, afin de s’assurer que la répartition d’électricité puisse être maintenue.

Tout ceci à également comme conséquence une augmentation du coût de l’énergie. Moins il y a d’offre par rapport à la demande, plus le prix du service augmente pour réguler cette demande. C’est mathématique et vieux comme le monde. Et ce n’est que le début.

Une étude prospective de l’ADEME (Agence de l’Environnement et de la Maîtrise de l’Énergie) publiée en janvier 2026 alerte sur deux points majeurs : la consommation énergétique des centres de données en France augmente rapidement, tandis que la production électrique française augmente moins vite que les besoins. Selon l’ADEME, en suivant une évolution tendancielle, la consommation d’électricité induite par les usages français pourrait progresser d’un facteur 3,7 d’ici 2035.

Selon RTE (Réseau de transport d’électricité), en 2050, les centres de données pourraient représenter 6% de la consommation d’électricité en France. Dans ses scénarios prospectifs, l’ADEME anticipe que leur consommation électrique serait multipliée par 5,5 sur le territoire français

Etant donné que les IA agentiques utilisent BEAUCOUP plus d’énergie que les IA génératives, et que ces agences étatiques n’ont très certainement pas anticipé ces nouveaux usages, nous serons très certainement face à des taux d’augmentation de la consommation bien plus élevés.

Contrats d’achat d’électricité à très long terme et problèmes de raccordement.

Bien conscients de ces problèmes, et pour sécuriser leur approvisionnement sur le long terme, les « Big Tech » signent des contrats spécifiques appelés PPA (Power Purchase Agreements), des contrats d’achat d’électricité à très long terme, directement auprès des producteurs.

Le principal fournisseur de Virginie du Nord (USA), Dominion Energy, a en 2026 un carnet de commandes pour les centres de données de 47 gigawatts, soit la puissance moyenne d’une quarantaine de réacteurs nucléaires !

Face à cela, Google, Microsoft, AWS, Meta, OpenAI, Anthropic et d’autres ont prévu 600 milliards de dollars d’investissements.

Satya Nadella (CEO de Microsoft) a résumé le problème ainsi : « Mon problème n’est plus l’approvisionnement en puces, mais le fait que je n’ai pas les bâtiments prêts à l’emploi pour les brancher. »

En effet, les délais de raccordement des nouveaux centres de données sur le réseau explosent. Olivier Micheli, le patron de Data4, avançait en 2025 que les délais de raccordement seraient « passés de deux à trois ans en moyenne à plus de cinq ans et même parfois sept ans ». Si les délais peuvent aller jusqu’à cinq ou sept ans en France, ils sont encore plus élevés à Francfort et à Londres, où ils atteignent 7 à 10 ans.

L’enfer administratif et la lourdeur étatique en France n’arrangeront pas les choses. Charles-Antoine Beyney, directeur général de DataOne, a exprimé en septembre 2025 son désarroi : « Créer un datacenter en France, c’est l’enfer : pour tirer 1,2 kilomètre de câbles, on nous annonce qu’il faut trois ans. »

En France, plus de 140 nouveaux projets d’usines ou de datacenters avaient signé un contrat de raccordement en février 2025, représentant une puissance de 21 gigawatts en continu, soit le double de l’énergie actuellement sollicitée par l’industrie française !

Ces contrats d’achat d’électricité à très long terme leur garantissent un approvisionnement prioritaire, cependant compte tenu de la très lente progression de la production électrique en France, ces contrats ne font-ils pas craindre des pénuries chez les citoyens des pays, dont la consommation énergétique pourrait être rationnée ?

Pour tenter de simplifier la mise en place de ces infrastructures et garantir une continuité de service, il ne sera pas étonnant à l’avenir de voir des entreprises technologies posséder leurs propres centrales nucléaires.

Écosocialisme et suicide du programme nucléaire français

Le 6 mars 1974, à la suite du choc pétrolier de 1973, la France engage le Plan Messmer, un vaste programme de construction de centrales nucléaires, qui aboutit à la construction de 58 réacteurs dans les années 80, assurant 75% de la production d’électricité.

La France est alors le pays le plus nucléarisé au monde, exportatrice d’électricité et indépendante énergétiquement.

Dans le contexte de la poussée du mouvement écologiste, le programme socialiste de François Mitterrand pour l’élection présidentielle de 1981 prévoit que « le programme nucléaire sera limité aux centrales en cours de construction, en attendant que le pays, réellement informé, puisse se prononcer par référendum ». Les Français choisissent tout de même le programme de François Mitterrand lors de l’élection présidentielle, les chantiers en cours sont menés à terme, mais aucune nouvelle centrale n’est commencée et le gouvernement décide de réduire le rythme des travaux.

Le 19 juin 1997, le Premier ministre Lionel Jospin annonce l’abandon du « surgénérateur » Superphénix (le réacteur à neutrons rapides à caloporteur sodium le plus puissant jamais opéré au monde). Le Superphénix de Creys-Malville est arrêté le 2 février 1998, et débute ainsi son démantèlement,

La commission d’enquête parlementaire pointe le rôle de Corinne Lepage et Dominique Voynet, respectivement ministres de l’Environnement ouvertement anti-nucléaires, qui reprochaient à EDF son « surinvestissement » dans le nucléaire.

Le Parti Socialiste et Europe Écologie-Les Verts signent, en novembre 2011, un « contrat de mandature » prévoyant une baisse de la part du nucléaire de 75% à 50% dans la production d’électricité d’ici 2025 et la fermeture de 24 réacteurs nucléaires, dont celle, rapide, de Fessenheim (aussi sous la pression des écologistes allemands).

La loi de transition énergétique pour la croissance verte (LTECV) votée en août 2015 pose deux principes dévastateurs pour le programme nucléaire français : la part du nucléaire ne devra pas dépasser 50% du mix électrique à l’horizon 2025, et la puissance nucléaire installée est plafonnée à 63,2 GW, condamnant mécaniquement la fermeture de réacteurs existants dès l’arrivée de tout nouveau réacteur.

En 2017, Emmanuel Macron poursuit la trajectoire de réduction : « 14 réacteurs de 900 MW seront arrêtés d’ici à 2035. Ce mouvement commencera à l’été 2020 avec l’arrêt définitif des deux réacteurs de Fessenheim. » Le réacteur numéro un de Fessenheim est mis à l’arrêt définitivement dans la nuit du 21 au 22 février 2020. La mise à l’arrêt définitif du second réacteur est quant à elle effectuée dans la nuit du 29 au 30 juin 2020. Selon la société française d’énergie nucléaire, l’arrêt de ces réacteurs entraîne des émissions additionnelles de l’ordre de 10 millions de tonnes de CO2 par an, en raison de l’importation nécessaire d’électricité provenant de centrales à charbon allemandes… tout sauf écologique !

Le 10 février 2022, lors du discours de Belfort, c’est le revirement : Emmanuel Macron annonce la construction de six réacteurs EPR2 (sur le modèle de Flamanville) avec mise en service du premier autour de 2035, et le lancement d’études pour huit EPR2 supplémentaires, ainsi que la prolongation de tous les réacteurs qui peuvent l’être au-delà de 50 ans.

La loi du 22 juin 2023 supprime l’objectif de réduction à 50% de la part du nucléaire et lève le plafonnement à 63,2 GW, effaçant ainsi les deux verrous posés par la loi de 2015 issue du quinquennat Hollande.

Cependant, après 40 ans de climat anti-nucléaire, de destruction de la filière nucléaire, et de désindustrialisation, que reste-t-il de la formation d’ingénieur ? Avons-nous d’ailleurs suffisamment d’ingénieurs pour construire en 10 à 20 ans 6 à 14 nouvelles centrales ?

Situation actuelle et baisse future de la production du nucléaire français

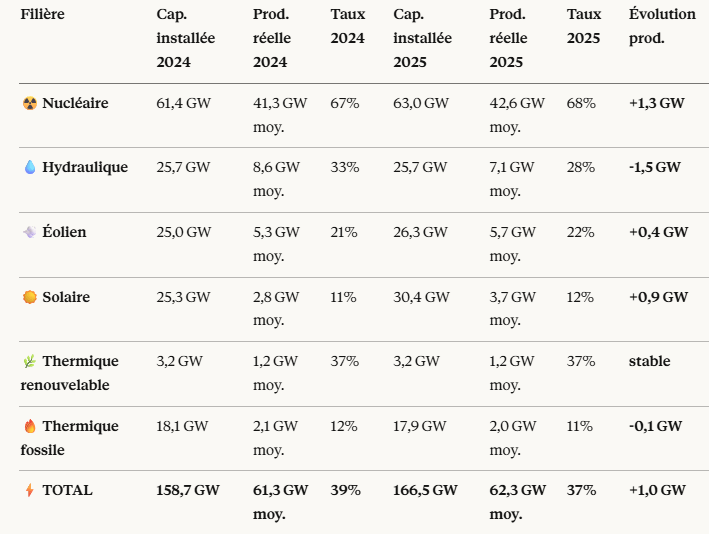

Malgré ce revirement, en 2025 la production nucléaire s’est établie autour de 42 gigawatts (63 GW de capacité), soit 1,3 GW de plus qu’en 2024. Au 4e trimestre 2025, le nucléaire représentait 68,2% de la production totale d’électricité française.

La France se classe au 2e rang mondial pour la puissance installée de ses centrales nucléaires avec 62,3 GW, soit 16,8% du total mondial, derrière les États-Unis (96,95 GW) et devant la Chine (56,45 GW). Elle compte 57 réacteurs nucléaires opérationnels répartis dans 18 centrales.

⚡ France – Capacité installée vs Production réelle 2024 & 2025

EDF prévoit une production nucléaire comprise entre 39,9 et 42,2 GW en moyenne par an en 2026 et 2027 anticipant une légère baisse, liée notamment aux arrêts de maintenance programmés des réacteurs et à la stagnation de la consommation des ménages.

Malgré la demande exponentielle en énergie pour les nouveaux centres de données en cours d’étude et de construction, EDF semble avoir intégré qu’il y aurait un délai de plusieurs années entre la demande et la fourniture d’énergie et ne semble pas pressé à augmenter sa production d’électricité compte tenu des délais de raccordement.

14 GW sont actuellement demandés pour de nouveaux centres de données sur un réseau qui installe environ 8 GW par an toutes filières confondues (notamment des énergies non pilotables, qui ne sont pas adaptées à l’utilisation de l’IA) mais en produit réellement que 1 GW supplémentaire par an (car les énergies renouvelables intermittentes sont… intermittentes et les constructions de centrales nucléaires prennent 10 ans minimum). Autrement dit, les nouveaux centres de données réclament à eux seuls l’équivalent de 1,6 ans de toute nouvelle installation française, et 14 ans de production réelle supplémentaire, un chiffre particulièrement éloquent pour illustrer la pression sur les infrastructures électriques de notre pays.

Vitesse d’adoption de l’IA vs temps de construction de nouvelles centrales

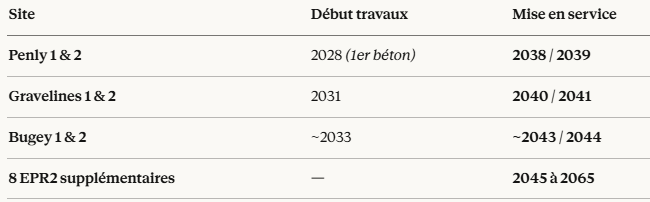

Nous l’avons vu, Emmanuel Macron a annoncé en 2022 la construction de 6 nouvelles centrales nucléaires, et l’étude de 8 EPR2 supplémentaires.

Voici le calendrier prévisionnel de mise en service de ces différentes centrales :

La durée moyenne mondiale de construction d’un réacteur nucléaire se situe autour de 10 années. Cependant EDF a perdu toute crédibilité quant à sa capacité à prédire la durée de construction d’un réacteur nucléaire avec le cas Flamanville, qui est le contre-exemple absolu : EDF a mis en service l’EPR de Flamanville en décembre 2024, après 17 ans de chantier et 12 ans de retard sur le calendrier initial. Le budget initial de 3,3 milliards d’euros a explosé pour atteindre 23,7 milliards d’euros, soit près de 7 fois le devis de départ.

En 4 ans nous sommes passés de l’IA générative, assez basique mais tout de même révolutionnaire, à de l’IA agentique, automatisée, et extrêmement gourmande en énergie.

Les 6 réacteurs EPR2, tous en service à l’horizon du milieu des années 2040 (s’il n’y a pas de retard…), apporteront à la France une puissance électrique installée supplémentaire de 10 GW… pour une demande actuelle de 14 GW supplémentaire uniquement pour de nouveaux centres de données !

Nos infrastructures énergétiques ne sont déjà pas capables de suivre les nouvelles fonctionnalités des IA de 2026, mais qu’en sera-t-il des IA d’ici 2040, c’est à dire dans 14 ans, lors de la mise en service du premier nouveau EPR2 ?

Pour ne pas être larguée dans la course à l’énergie, ce ne sont pas 6 réacteurs EPR2 qu’il nous faudrait, mais 60 au minimum.

Nous voyons bien que tout cela n’est pas tenable, à court, moyen et long terme, et que nos dirigeants n’ont aucunement conscience des enjeux civilisationnels que cela représente.

Je ne vois donc que deux possibilités à l’avenir :

- Soit nous acceptons collectivement, mondialement, que la technologie va beaucoup trop vite et trop loin par rapport à nos infrastructures, et qu’il est plus prudent de tempérer nos ardeurs (pour des raisons morales également, comme réfléchi par le Vatican dans Quo Vadis, Humanitas ?).

- Soit la Chine, qui a un système politique beaucoup plus réactif, continuera de mettre les bouchées doubles pour nous surpasser et nous écraser technologiquement (et militairement).

La démocratie comme frein structurel

En démocratie, et surtout dans un pays très bureaucratique comme le nôtre, chaque décision énergétique ou industrielle majeure doit traverser des années de débat public, d’études d’impact, de recours juridiques, de négociations politiques. En Chine, le Conseil d’État approuve 10 réacteurs en une seule réunion. Ce n’est pas une question d’intelligence ou de volonté, c’est une question de système de décision et de système politique.

En mars 2026, la Chine compte 61 réacteurs nucléaires opérationnels et 36 réacteurs en construction, ce qui la place au 1er rang mondial pour le nombre de réacteurs en construction, loin devant tous les autres pays.

Depuis 2022, la Chine approuve 10 nouveaux réacteurs par an. L’ensemble de son programme coûtera moins de 28 milliards d’euros, et chaque centrale demande moins de 56 mois de construction, un niveau de performance rendu possible par une industrialisation très poussée et une filière industrielle très mobilisée.

La France a construit l’EPR2 de Flamanville en 17 ans pour 23,7 milliards d’euros quand la Chine a construit 11 réacteurs en moins de 5 ans pour 28 milliards au total.

Le temps de construction d’un réacteur en Chine s’élève à 5,7 ans en moyenne, contre une estimation de 10 ans en France (17 ans à Flamanville, mais c’était le premier EPR2) et 8,6 années aux États-Unis.

En prenant en compte les unités en construction ou récemment approuvées, la puissance nucléaire chinoise atteindra prochainement 113 GW sur 102 réacteurs. La Chine sera la seule nation à exploiter plus de 100 réacteurs d’ici 2030.

Peut-on imaginer une seule seconde le successeur politique d’Emmanuel Macron, ou un candidat du Parti Socialiste et de LFI, commander 50 centrales nucléaires en un quinquennat, quand la majorité de leur électorat (les moins de 25 ans comme les plus de 60 ans) est pour la destruction de la filière nucléaire ?

La question de la rentabilité des IA.

Il y a quelques jours, après seulement 6 mois d’activité, OpenAI a annoncé la fermeture de « Sora », son réseau social de vidéos courtes générées par IA.

L’application avait pourtant atteint les sommets des classements dès son lancement avec 3,33 millions de téléchargements en novembre 2025.

Avec un nombre de téléchargements en chute libre à 1,1 million en février 2026, elle comptait pourtant qu’un million d’utilisateurs actifs, qui passaient 13 minutes par jour en moyenne sur l’application (contre 90 minutes pour les utilisateurs de TikTok).

Le coût d’inférence (coûts directs et indirects) estimé de Sora était d’environ 15 millions de dollars par jour, pour des revenus totaux générés par l’application, sur toute sa durée de vie, de… 2,1 millions de dollars ! Des pertes absolument vertigineuses.

Là où des acteurs comme Adobe avec Firefly ou Runway facturent à l’usage, OpenAI avait intégré Sora dans son abonnement premium sans véritable limite de consommation, une approche attractive pour les utilisateurs, mais économiquement insoutenable à grande échelle.

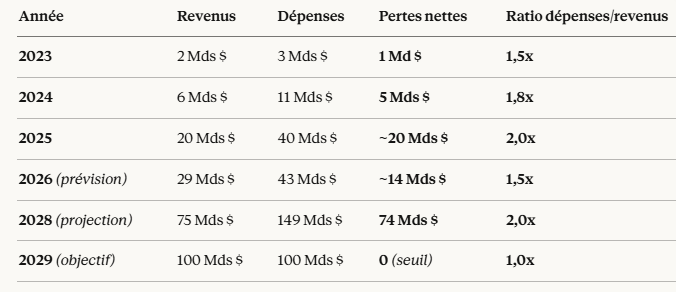

Concernant la rentabilité globale d’OpenAI, passée, présente et les prévisions futures :

💸 OpenAI — Bilan financier année par année

Comme nous pouvons le voir, la rentabilité d’OpenAI est, depuis ses débuts, très mauvaise.

OpenAI dépense 2 dollars pour chaque dollar de revenu généré. Les projections financières du Wall Street Journal montrent que les pertes vont s’amplifier de manière exponentielle : en 2028, OpenAI prévoit des pertes opérationnelles de 74 milliards de dollars, soit presque autant que les revenus attendus la même année. La trajectoire déficitaire cumulative devrait atteindre 115 milliards de dollars entre 2025 et 2029.

Sam Altman, lui-même , le co-fondateur d’OpenAI, a admis en 2025 croire qu’une bulle IA est probablement en cours. La Banque d’Angleterre a également averti des risques croissants d’une correction du marché mondial en raison d’une possible surévaluation des entreprises technologiques leaders dans le domaine de l’IA.

Conclusion

Et si nous étions en Occident à l’aube d’une énorme bulle de l’IA qui entrainerait une crise financière, si ce n’est pire encore ?

Comme nous l’avons vu, l’économie ce n’est que de l’énergie transformée, et les infrastructures énergétiques en Occident ne sont pas du tout à la hauteur des enjeux liés à l’IA, elles sont déjà en tension, et les délais pour installer de nouvelles capacités de production nucléaire sont d’environ 10 ans, notamment à cause d’une lourdeur bureaucratique, politique, et d’un manque de formation d’ingénieurs dans nos écoles.

La Chine quant à elle est beaucoup plus armée pour remporter la bataille énergétique, grâce à une grande capacité à prendre des décisions politiques rapidement et à exécuter ses choix stratégiques.

Cependant la faible rentabilité actuelle des services proposés par les entreprises d’IA, que ce soit leur propre rentabilité ou le retour sur investissement de leurs clients, risque de ralentir sérieusement l’adoption de ces avancées technologiques, et de faire éclater la bulle IA en bourse, et donc d’entraîner une crise financière.

Si la Chine arrive à maintenir, et même à augmenter, sa capacité à sortir de terre des centrales nucléaires en des temps et à des coûts records, arrivant à être rentable par une abondance d’énergie, le déclassement de l’Occident risque d’être fatal.

Comme l’Empire Romain s’est effondré quand il a notamment perdu le contrôle de ses aqueducs, la civilisation occidentale, vieillissante et antinataliste, pourrait connaître le même sort sous le poids démographique, technologique et énergétique de la Chine.

Pendant que nos élus débattent, réglementent, régulent, normalisent et taxent, la Chine construit. Pendant qu’elle construit, nous votons notre propre obsolescence.